Choisir un modèle d’IA pour un client, c’est rarement évident. Les benchmarks officiels mesurent des choses qui ne sont pas forcément ce dont mes clients ont besoin. Alors plutôt que de croire la communication des éditeurs sur parole, j’ai construit mon propre banc d’essai.

Le problème : trop de modèles, pas assez de critères

Tous les mois, de nouveaux modèles d’IA arrivent. Chacun annonce être meilleur que les précédents, plus rapide, plus précis, plus créatif. Et le pire, c’est que c’est parfois vrai. Mais vrai sur quoi, exactement ?

Quand un client me demande quelle IA utiliser pour son cabinet ou pour sa structure, je ne peux pas répondre avec les classements en ligne. Le besoin d’un expert-comptable n’est pas celui d’un artisan, qui n’est pas celui d’une médiathèque. Et un modèle excellent en code peut être catastrophique pour rédiger un post Instagram qui sonne juste en français.

Il me fallait un endroit pour comparer les modèles sur ce qui compte vraiment dans mon métier : la rédaction en français naturel, le raisonnement pas-à-pas, la synthèse de documents, l’écriture de posts professionnels. Et surtout, un endroit où je pourrais comparer deux modèles côte à côte, sur le même prompt, dans les mêmes conditions.

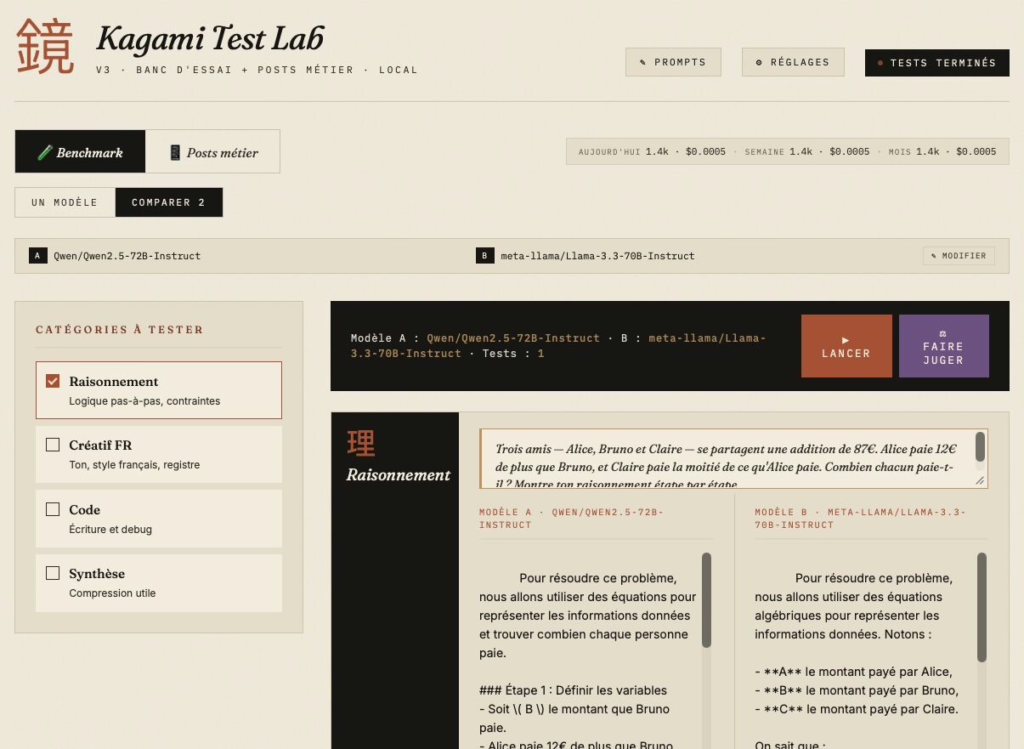

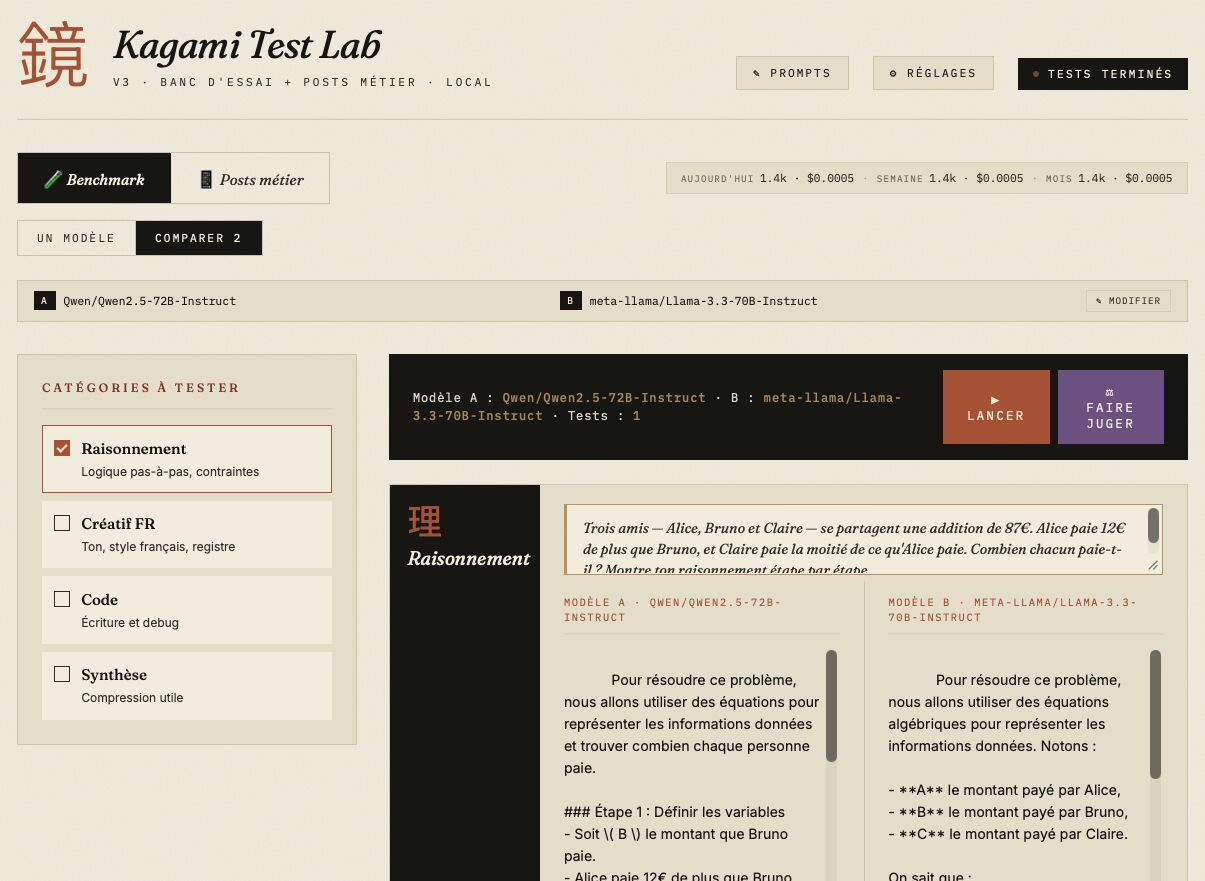

Kagami Test Lab : à quoi ça ressemble

L’idée est simple. Je choisis un ou deux modèles. Je sélectionne une catégorie de test (raisonnement, créatif français, code, synthèse). Je lance. Les modèles répondent en parallèle. Je lis, je note, j’archive. C’est tout.

Sur cet exemple, je teste deux modèles open source sur un petit problème de raisonnement (un partage d’addition entre trois amis). Les deux modèles voient le même énoncé, prennent leur temps, et me rendent leur copie. À gauche, l’un démarre par poser des équations. À droite, l’autre fait un peu différemment. Je peux comparer leur démarche, pas seulement leur réponse finale.

Quatre catégories sont disponibles dans le panneau de gauche : raisonnement pour les problèmes logiques, créatif français pour vérifier la qualité de l’écriture, code pour les tâches de développement, et synthèse pour la compression utile d’un texte long. Je peux activer celles qui m’intéressent et tout lancer d’un coup.

L’astuce qui change tout : un juge aveugle

Comparer deux modèles à l’œil, c’est bien. Mais c’est subjectif, et je suis biaisé. Si je sais qu’un des deux est censé être meilleur, je vais le voir meilleur. C’est humain.

J’ai donc ajouté un juge IA qui évalue les réponses à ma place, en plus de mon propre avis. Concrètement, après chaque test, je peux cliquer sur un bouton qui envoie les deux réponses à un troisième modèle (Claude, en l’occurrence) avec une consigne précise : noter chaque réponse sur quatre critères, désigner la meilleure, et expliquer pourquoi.

Le détail qui rend ça honnête : le juge ne sait pas qui est qui. Les réponses lui sont présentées dans un ordre aléatoire, sans nom de modèle. Il ne sait pas si la « Réponse 1 » vient de Qwen ou de Llama. Une fois son verdict rendu, je remappe pour l’affichage. Le juge ne peut donc pas être influencé par la réputation des modèles, par la place sur l’écran, ou par quoi que ce soit d’autre que la qualité brute des réponses.

Au final, j’ai donc deux avis pour chaque test : le mien (subjectif, mais expert), et celui du juge (aveugle, mais bête sur les nuances). Quand les deux convergent, je suis confiant. Quand ils divergent, je creuse pour comprendre pourquoi. C’est dans ces désaccords que j’apprends le plus sur les modèles.

Et puis j’ai poussé un peu plus loin

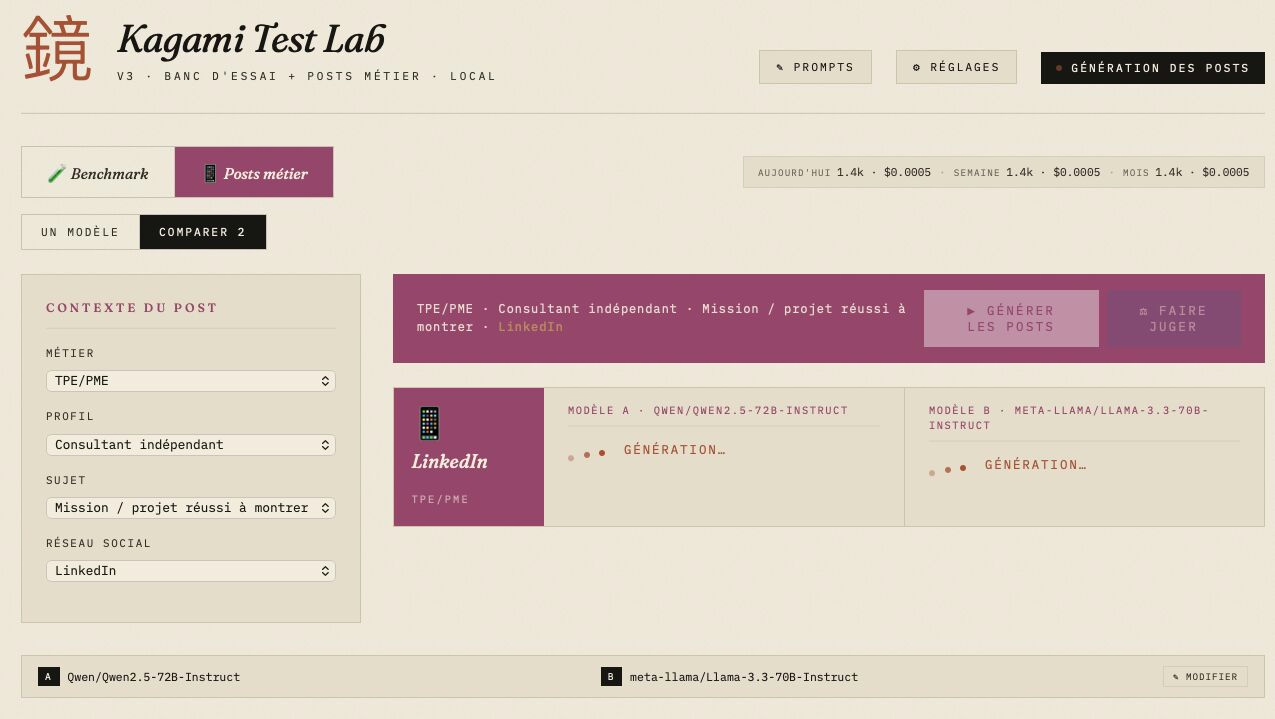

Une fois le banc d’essai fonctionnel, l’envie m’a pris de tester les modèles sur quelque chose de plus concret pour mes clients : la rédaction de posts pour les réseaux sociaux. Parce qu’au-delà des problèmes de logique, ce que mes clients me demandent souvent, c’est de l’aide pour communiquer.

J’ai donc ajouté un second mode où je peux configurer un contexte précis avant de générer. Je choisis un métier, un profil, un sujet, un réseau social, et je lance la comparaison entre deux modèles.

Sur cet exemple, je veux voir comment deux modèles vont rédiger un post LinkedIn pour un consultant indépendant qui souhaite communiquer sur une mission qui s’est bien passée. Le ton attendu n’est pas le même que pour un boulanger sur Instagram, ni pour un musée sur Facebook. Les contraintes du réseau (longueur, hashtags, ton, présence d’émojis) sont automatiquement intégrées dans la consigne envoyée aux modèles.

Et bien sûr, le juge IA évalue aussi ces posts, mais avec des critères différents : respect des contraintes du réseau, naturel du français, qualité de l’accroche, et adéquation avec le profil métier. Parce qu’un post qui sonne juste pour un consultant ne sonne pas juste pour un artisan, et un juge correct doit savoir le différencier.

Tout est archivé pour devenir utile plus tard

Le piège classique avec ce genre d’outil, c’est de tester plein de modèles, de prendre des notes mentales, et de tout oublier la semaine suivante. J’ai donc ajouté un archivage automatique dans Notion à chaque évaluation.

Chaque test devient une fiche Notion avec le modèle, la catégorie, ma note, le verdict du juge, le prompt utilisé, et les coûts estimés. Au bout de quelques semaines, j’ai une base de connaissances que je peux interroger en langage naturel : « quel modèle a été le plus rapide en code ? », « parmi les posts LinkedIn, lesquels sont marqués utilisables en démo client ? », « quels sont les tests où le juge et moi étions en désaccord ? ».

Cette mémoire, c’est ce qui transforme un outil de test en outil d’aide à la décision. Quand un client m’appelle pour un projet, je peux puiser dans cette base pour orienter mon choix de modèle, plutôt que de partir des classements génériques en ligne.

Quelques chiffres concrets

Question qu’on me pose souvent : combien ça coûte de tester ? La réponse va surprendre. L’écran affiche un compteur estimatif en haut à droite, et après plusieurs jours d’utilisation intensive, je suis à environ 0,0005 dollar. Pas par test, par mois.

C’est tellement bas que ça en est presque suspect. Mais c’est la réalité quand on utilise les modèles open source via les hébergeurs gratuits qui les proposent. Pour information, j’ai construit toute la mécanique en six heures de travail entrecoupées. Et l’investissement total, en cumulant l’hébergement et l’utilisation, reste sous le coût d’un café par mois.

Ce détail compte parce qu’il change la posture. Tester ne coûte plus rien. Donc je teste plus souvent, sur plus de modèles, sans avoir l’impression de gaspiller. C’est précisément ce qui permet d’avoir une opinion éclairée plutôt qu’une opinion par défaut.

Et la suite ?

L’outil continue d’évoluer. La prochaine étape, c’est de pouvoir tester aussi des modèles qui tournent complètement en local, sans aucun appel à un serveur extérieur. C’est important pour les clients qui manipulent des données sensibles et qui ne veulent ni ne peuvent envoyer leurs documents sur des plateformes externes. Avocats, experts-comptables, professions médicales, certaines administrations.

Je veux aussi pouvoir comparer plus de juges, parce que demander à une seule IA de juger les autres, ça reste un point faible. Avoir plusieurs juges qui votent serait plus solide.

Et à terme, l’idée est d’interconnecter cet outil avec d’autres outils maison que je développe pour HOCUSBOOKUS. Un dashboard central où je pourrais voir d’un coup d’œil quels modèles tournent, sur quels projets, avec quels résultats, et basculer rapidement de l’un à l’autre. C’est un peu plus loin sur la feuille de route.

Pourquoi je raconte tout ça

Bon, j’avoue, je suis plutôt content du résultat. Et au-delà de la fierté de bricoleur, ce projet illustre exactement ce que j’essaie de faire passer en formation et en accompagnement : l’IA n’est pas une boîte noire à laquelle il faut faire aveuglément confiance. C’est un outil qu’on peut tester, comparer, mesurer. Avec un peu de méthode, on peut prendre des décisions éclairées plutôt que de suivre la mode.

Quand j’arrive chez un client pour une formation ou un accompagnement, je viens avec cette pratique. Je connais les modèles parce que je les teste. Je sais leurs forces et leurs limites parce que je les ai mis face à face. Et quand je recommande tel ou tel outil, c’est sur la base d’un usage réel, pas d’une fiche commerciale.

Si tu te demandes quelle IA pourrait servir dans ton cabinet, ton agence ou ta structure, et que tu n’as pas envie de te perdre dans les comparatifs en ligne, on peut en parler. C’est exactement ce que je fais au quotidien.

Un projet IA qui mérite mieux qu’un essai au hasard ?

Que tu sois indépendant, dirigeant de TPE-PME ou responsable d’une structure publique, on peut discuter de ton besoin et identifier ce qui ferait vraiment sens pour ton activité. Sans hype, sans jargon, avec des cas concrets.